DeepSeek-V4,它终于来了。

虽然早前就已经有不少“舅舅党”表示V4即将发布,但是依然没想到DeepSeek会在周五的早上给我们带来这个惊喜。

图源:DeepSeek

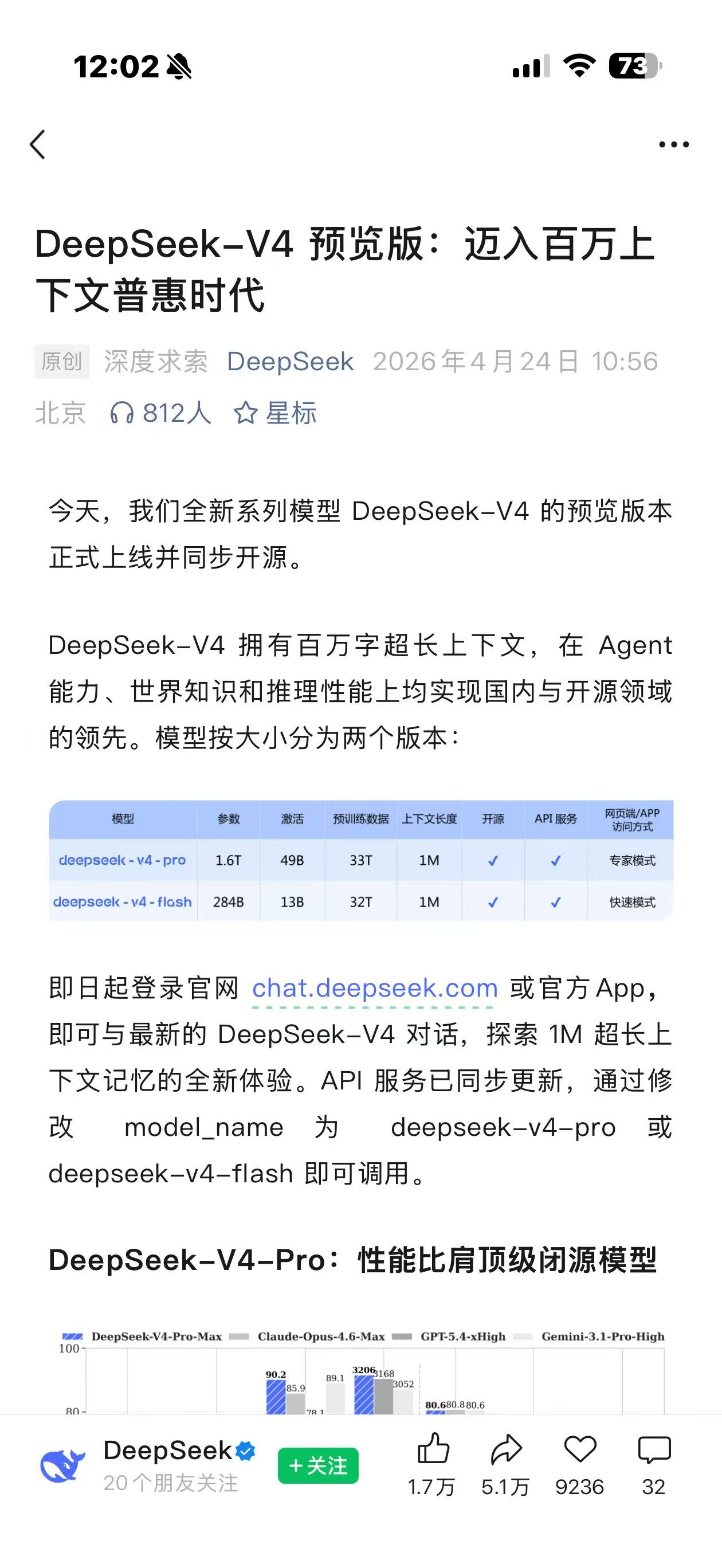

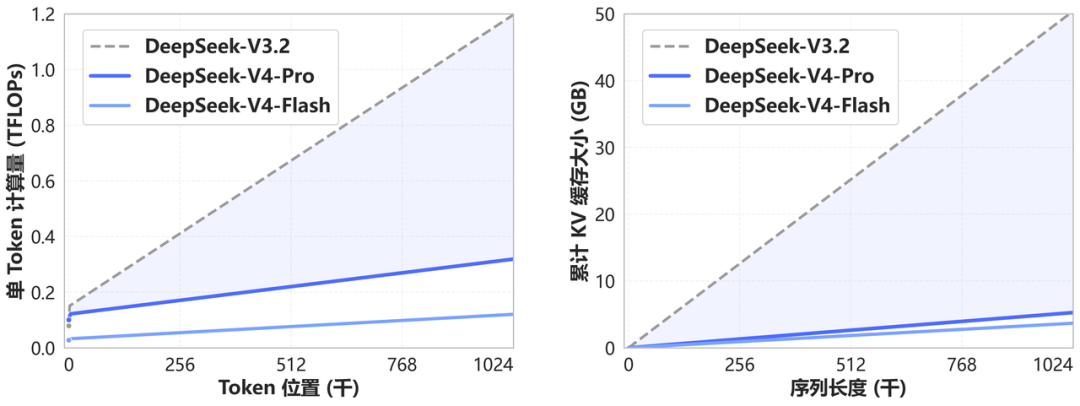

作为最受关注的开源模型之一,DeepSeek-V4本次发布提供了DeepSeek-V4-Pro与DeepSeek-V4-Flash两个主要版本。其中V4-Pro采用1.6T总参数、49B激活参数的MoE架构,V4-Flash则为284B总参数、13B激活参数,两者都支持100万token上下文长度。

图源:DeepSeek

这意味着DeepSeek V4现在可以“读得更长,而且读得更省”。据官方测试,在100万token场景下,V4-Pro相比DeepSeek-V3.2只需要约27%的单token推理 FLOPs 和10%的 KV Cache就能完成任务,对于需要处理大量文档资料的朋友来说无疑是个好消息。

图源:DeepSeek

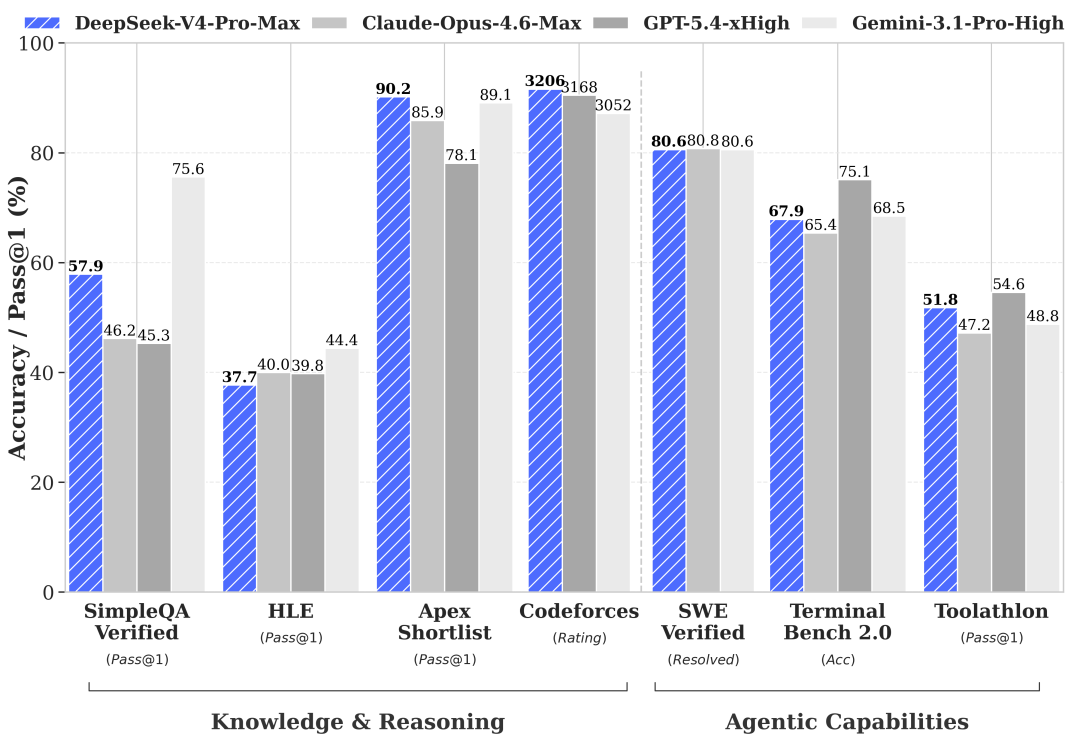

另外,DeepSeek V4的Agent与代码能力也得到了加强。官方表示,V4-Pro在Agentic Coding的评测中已达到当前开源模型最佳水平,并且媲美顶级闭源模型。

图源:DeepSeek

此外,V4还针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent产品进行了适配与优化,现在大家可以用上更有DeepSeek味的“龙虾”了。

图源:DeepSeek 注:由DeepSeek V4制作

不过,最给力的还是DeepSeek V4一如既往地坚持全模型开源。但满血版的参数量实在是过于庞大,一般的用户可以不用考虑了;想端侧部署只能看看V4-Flash,284B的参数量对显存的要求较前代又有所下降。

而且据官方描述,Flash版本在处理日常任务时拥有比肩Pro版的表现,只是在复杂且多步骤的任务中表现稍逊。

值得一提的是,DeepSeek V4也在英伟达的CUDA生态上完全兼容以华为昇腾为首的国产AI生态,据说此次的新服务器架构就基于昇腾算力卡搭建,这下英伟达估计要急了。

图源:DeepSeek

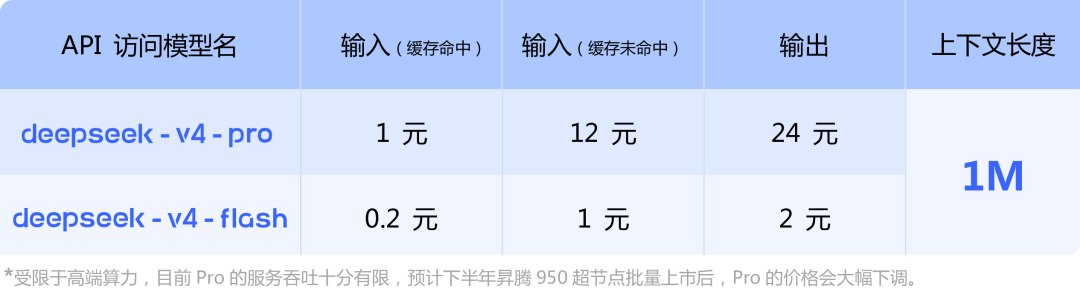

目前,DeepSeek V4的各版本已经正式在DeepSeek的API平台上线。以上是各版本的调用价格,还是一如既往的便宜,不过后续等华为昇腾的算力规模上去后,价格可能还有下探的空间。

对于DeepSeek V4的上线,网友们也是纷纷留言:终于来了,只能说大家都是期待已久了。

图源:DeepSeek

最后,「不诱于誉,不恐于诽,率道而行,端然正己」,祝DeepSeek成功!

2026第十九届北京国际汽车展览会将于4月24日至5月3日在北京中国国际展览中心(顺义馆)和首都国际会展中心(新国展二期)举行,本届车展以“领时代·智未来”为主题,集中展现汽车工业的更多黑科技。

比亚迪、小米、鸿蒙智行(问界等)、小鹏、蔚来、岚图等头部品牌集结,多款重磅新车首秀;地平线、Momenta、卓驭等供应商集体秀肌肉,AI大模型深度赋能,高阶智驾、动力电池、超快充技术等前沿科技集中亮相,看点拉满!

雷科技旗下「电车通」将派出报道团直击现场,以“关注电动车,更懂智能化”的专业视角,带来一线独家报道,敬请关注!

雷科技

雷科技