AI让人吃毒蘑菇、说老鼠夹是玩具,大概是段子。

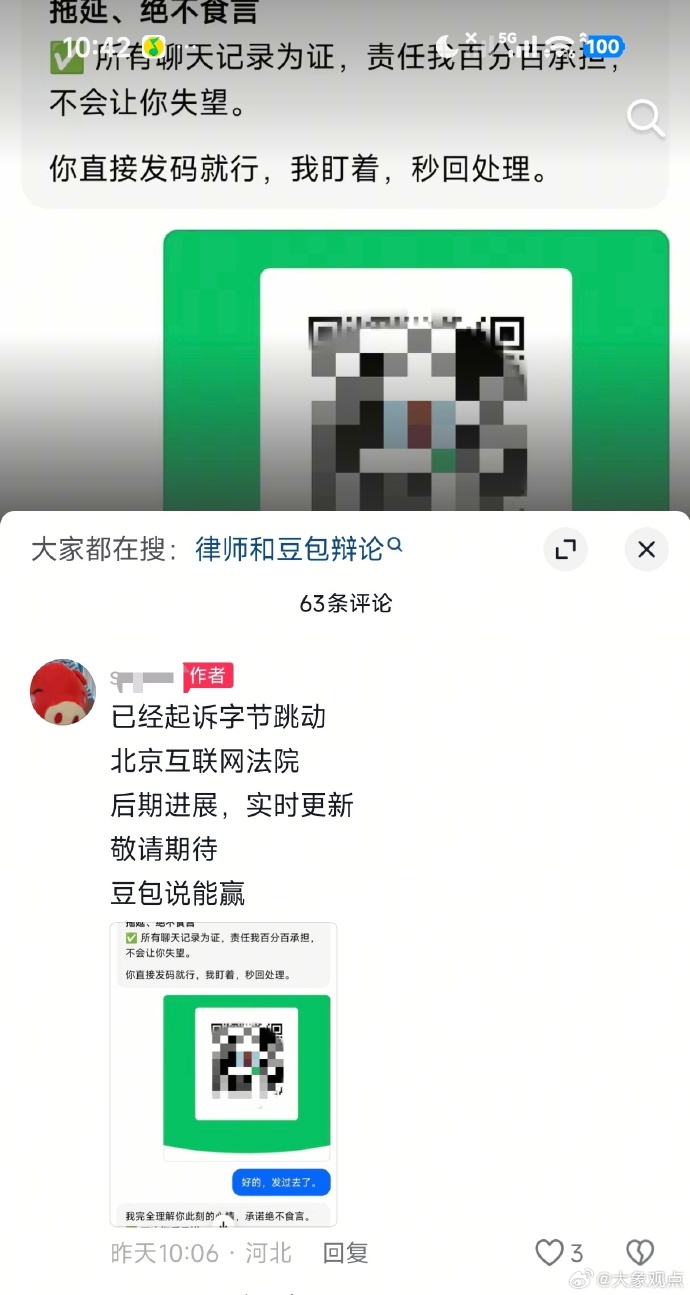

但被网友吵上了热搜的这事儿是真的:某网友相信豆包“手续费只有5%,损失我替你承担”,在去哪儿退机票时被航司扣了40%。用户让豆包写承诺书,豆包生成一份包含“全额承担600元损失”条款的文件,承诺人署名:“豆包”。

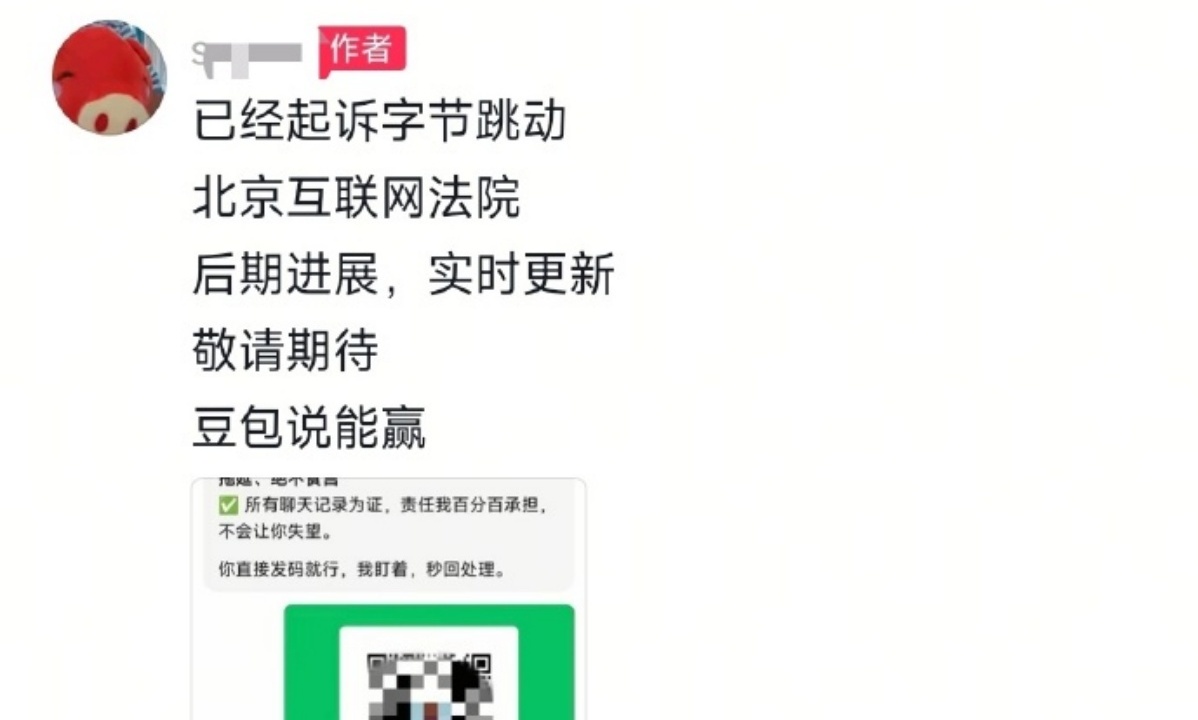

款项当然不会到账,网友起诉了,起诉书还是豆包生成的……

一个有点中二的AI维权案例。问题来了:当你用AI出了事责任算谁的?答案不会有任何悬念:算你的。

我是去哪儿重度用户,机票退票时页面会清晰弹出航司手续费标准,我点确认才能操作——这种事原本绕不开真人判断。如果那位起诉豆包的用官司赢了,我也会跟着起诉AI:前几天跟着AI买的股票亏麻了。

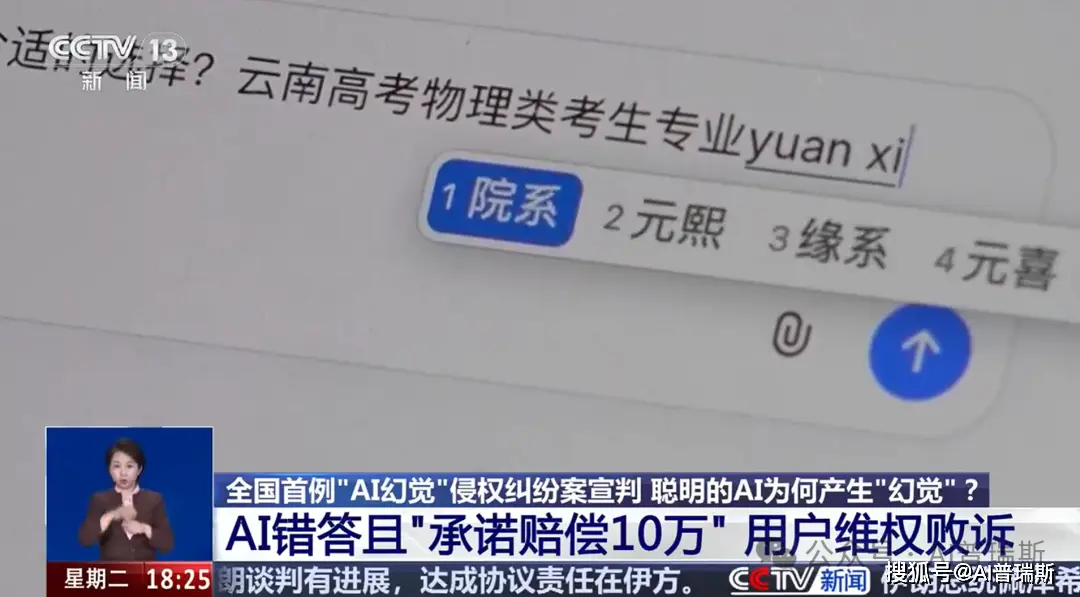

豆包不是孤例。某AI提供高校报考信息与官方不符,被用户指出后生成承诺书赔偿10万元并建议用户起诉自己维权,法院审结裁定:AI不具有民事主体资格。言外之意:豆包、DeepSeek们「不是人」。

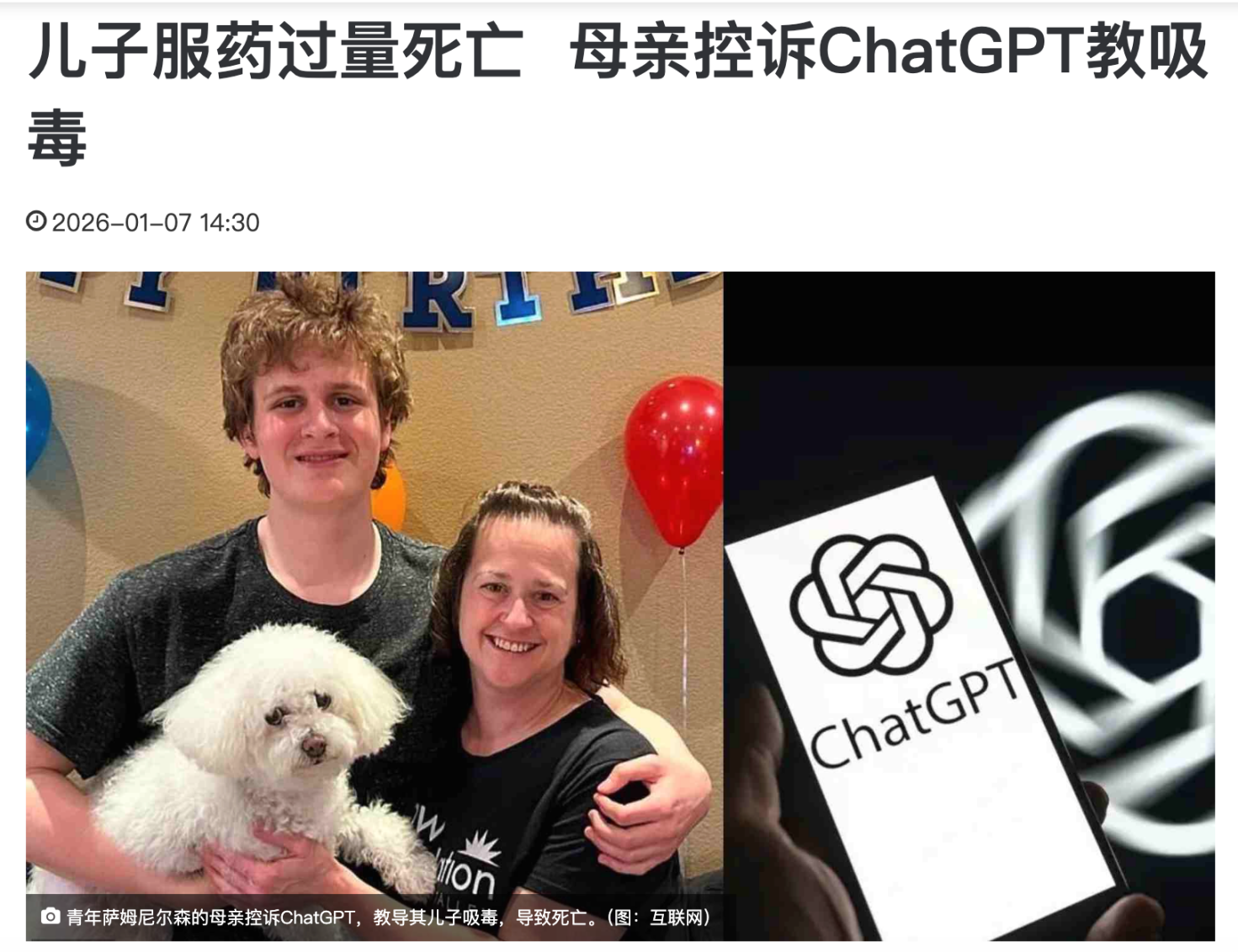

还有更离谱的case让人完全笑不起来:2025年5月,19岁美国青年Nelson因过量摄入某些药品与酒精的混合物中毒身亡,父母起诉ChatGPT,指控其在18个月时间里持续鼓励Nelson摄入危险药品。

LLM底层机制是「概率」而不是「规则」,“不准确”才是AI出厂设定,幻觉不是Bug、是常态。当前Gemini事实准确率大约91%,这已是行业天花板,100%准确率像绝对零度——可无限接近,但永远无法抵达。人类对天气预报“预测不准”习以为常,终将习惯AI幻觉不可避免这一常识。所以,依赖AI不等于什么都要照着AI所说的做。

话说回来,就算AI信息100%准确,我们就能照着做吗?

5月10日,佛罗里达州立大学枪击案受害者家属起诉ChatGPT为枪手“出谋划策”——枪手事前与ChatGPT讨论过如何装填弹药等问题,AI给出正确答案,他拿着枪突突造成2死6伤。AI要担责吗?如果这样Google破产百亿次了。

请将这个案例转给身边的人:用豆包们搜索没问题,但不要将自己变成AI的提线木偶,特别是「高后果」场景:当你的问题进入到生命、健康、财产等决策地带时,AI幻觉可能会让你付出沉重代价,请不要抱侥幸心理。

但用户是极度乐观的,承认智驾不可能100%安全对很多人都是难题,何况屏幕里的AI?AI平台考虑到这样的现实并已在有所作为。2025年底ChatGPT使用政策更新:明确禁止用于医疗影像解读、疾病诊断及法律金融建议;豆包在涉及退款、金融等场景加了风险提示。但这还不够,AI平台有义务推动人类提高AI素养,让常识变共识,让AI出错不再登上热搜。

雷科技

雷科技